Tin tức

Cảm biến LiDAR Là Gì? Tại Sao APPLE Lại Dùng Vào Camera Trên IPHONE 12 Thay Vì ZOOM

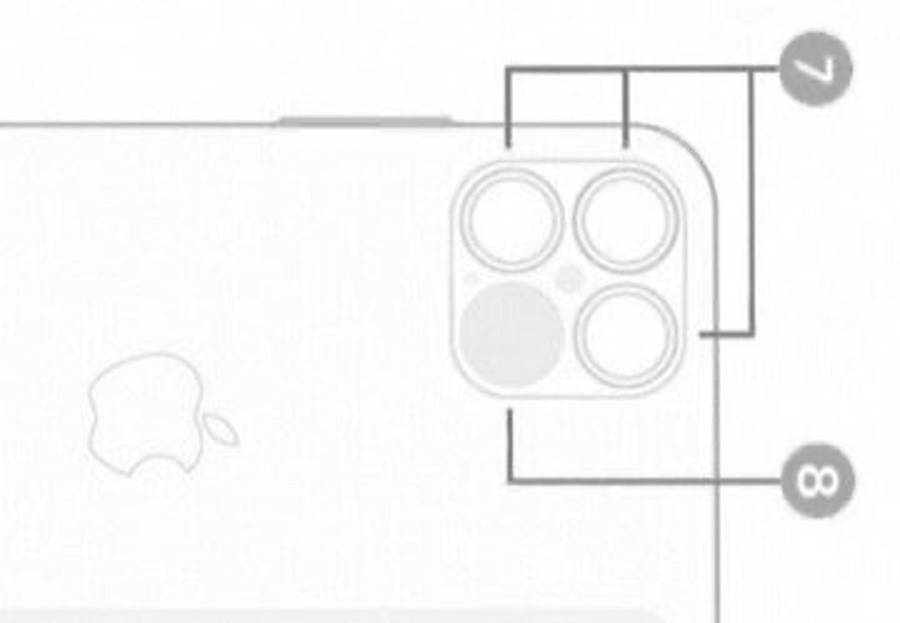

Chiếc iPhone đầu tiên có 4 camera

LiDAR dùng để làm gì?

Trong nhiều năm qua, Apple vẫn giữ số “chấm” camera chỉ ở mức dưới 16MP và có kích cỡ khá nhỏ chỉ bằng khoảng 50% so với các đối thủ cạnh tranh. Tuy nhiên năm nay Táo Khuyết hứa hẹn sẽ tập trung vào camera LiDAR trên iPhone 12 – một cảm biến thứ 4 thay vì zoom “khủng” như Samsung, OPPO và Huawei. Cùng ShopDunk đi tìm hiểu nhé!

Dựa theo các thông tin được Concepts iPhone và tài khoản Twitter Choco_bit lần mò từ mã nguồn của iOS 14, thế hệ iPhone mới sẽ có 4 camera ở mặt sau. Cảm biến được thêm mới sẽ không phải là camera ToF (đo chiều sâu) như các hãng Android thường làm hiện nay, thay vào đó là cảm biến LiDAR.

“LiDAR” là viết tắt của cụm từ “Light Detection And Ranging”, tạm dịch: Phát hiện và Đo lường Ánh sáng. Công nghệ này có nguyên lý hoạt động khá giống với radar: phát sóng tới các vật thể và đo thời gian sóng quay trở lại để tính toán khoảng cách từ vật thể đó tới cảm biến.

LiDAR sử dụng ánh sáng laser trong dải tần xanh mà mắt người không nhìn thấy được trong khi radar sử dụng sóng vô tuyến (radio). Trên các thiết bị lớn, LiDAR có thể được sử dụng giúp cho máy tính có thể “nhìn” được các vật thể, số hóa toàn bộ không gian xung quanh cảm biến.

Trước hết, hãy cùng trả lời câu hỏi: LiDAR để làm gì. Như bạn có lẽ đã đoán ra, đây là công nghệ giúp cho máy tính có thể “nhìn” được môi trường – quan trọng nhất là nhìn 3D chứ không phải là 2D. So với các công nghệ “nhìn” 3D trước đây, mà điển hình là sử dụng camera kép (iPhone 7 Plus) hay pixel kép (Google Pixel 2), Lidar đem đến độ chính xác cao hơn hẳn.

Trong giới hi-tech, LiDAR không phải là một công nghệ quá mới mẻ. Công nghệ này thường xuyên được đề cập trong giới xe tự lái khi được dùng trên xe của Tesla, Google hay cảm biến của Bosch. Các lĩnh vực đòi hỏi máy móc phải tự xây dựng được mô hình 3D trong không gian như địa chất, nông nghiệp, an ninh…cũng đang nghiên cứu ứng dụng LiDAR.

Với riêng Apple, LiDAR cũng trở thành công cụ vô cùng hữu ích cho thực tại tăng cường (Augmented Reality, hay gọi tắt là “AR”), một công nghệ là CEO Tim Cook đã liên tục ca ngợi trong nhiều năm qua. Trong AR, các vật thể ảo được sắp đặt lên trên môi trường thật. Để làm được điều này, thiết bị số trước hết cần “nhìn” được chính xác vị trí của từng vật thể thật trong không gian. iPad vốn không cần đến LiDAR đã có thể hỗ trợ được AR, nhưng chắc chắn sự có mặt của cảm biến mới sẽ giúp tạo ra một bước tiến lớn cho công nghệ này trên thiết bị gắn mác Táo.

Nếu là một nhà sản xuất thông thường, Apple có lẽ đã theo chân Samsung và các nhà sản xuất Android “đua số” camera. Nhưng Apple không phải là một thương hiệu “thường”. Trong nhiều năm, dù thất thế trước các đối thủ khi thông số phần cứng hay trên bảng xếp hạng DxOMark, iPhone vẫn cứ là bá chủ của phân khúc cao cấp.

iPhone 12 cũng sẽ không phải là ngoại lệ, khi người dùng chỉ cần camera “đủ tốt” chứ không cần camera “tốt nhất”. Dù điểm DxOMark thua xa các đối thủ từ Huawei, Samsung hay Xiaomi, những chiếc iPhone vẫn luôn thống trị các bảng xếp hạng smartphone bán chạy nhất toàn cầu.

Chính vì vậy, Apple không cần quá đặt nặng vào chất lượng ảnh nữa. Còn camera LiDAR nói riêng và công nghệ AR nói chung lại mang đến một lợi thế hoàn toàn mới: đây sẽ là trải nghiệm mà chỉ riêng Apple tập trung theo đuổi trên thiết bị di động vào thời điểm này. Công nghệ AR của các hãng khác giờ chủ yếu được phát triển trên các thiết bị riêng biệt (ví dụ như kính của Microsoft); AR của Android chủ yếu chỉ tồn tại trên một vài dự án nghiên cứu nhỏ của Google. Ngay cả smartphone Pixel giờ vẫn chưa có tính năng AR nổi trội nào, mặc dù đã được trang bị cảm biến radar trên mặt trước.

Như vậy, camera LiDAR trên iPhone 12 sẽ là một bước tiến lớn mở ra công nghệ AR trong tương lai. Cùng với hệ điều hành iOS 14, công nghệ 5G và hàng loạt nâng cấp khác sẽ giúp thế hệ Táo khuyết tiếp theo của nhà Apple được các tín đồ đón nhận và gặt hái được nhiều thành công.